近年、さまざまな業種・業態において労働力不足が社会的課題となっており、ロボットを使って人の作業を代替する取り組みが盛んに行われている。こうした中、人からの言葉の指示によってロボットに作業を代替させる技術は、ロボット制御に関する専門知識を必要とせず、ユーザーが話しかけるだけでロボットに作業の内容を伝えることができる技術として期待が高まっている。

他方、現在実現されているシステムの多くは、箱の中から指示した物を掴み移動させるといった特定のシーンにおけるロボット制御にとどまっている。様々なシーンでロボットに作業を代替させるためには、作業の目的からそれに必要となる動作の一覧を生成でき、それに基づいてロボットを簡単に制御できるアルゴリズムが必要。これらの課題に対して、人からの自然言語指示で様々なシーンにおいてロボットを制御するアルゴリズムの研究開発を、OSXと京都大学、東京工業大学、奈良先端科学技術大学院大学による共同研究プロジェクトとして取り組む。

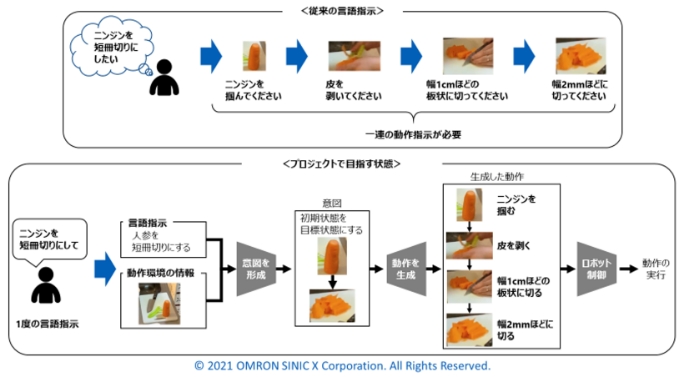

自然言語指示によるロボット制御研究の多くは、「モノを掴む」や「部屋を移動する」といった単純な動作にとどまっている。そこで、本プロジェクトでは、作業工程の写真や、実際に人間が作業している動画をもとに、機械学習によって自然言語指示と動作環境の情報から、「初期状態」を「指示内容を実行した後の状態」にするという動作の“意図”を形成し、作業に必要となる動作を生成するアルゴリズム開発を行う。

また、生成された動作は学習データとしている人の動作に基づいているため、ロボットでその動作を実現するためには、人とロボットの身体性の違いを考慮し、ロボットに合わせた制御方法を実現する必要がある。そこで、本プロジェクトでは、人とロボットの身体性の違いによる影響を解決するために、「道具の使い方」に着目。「道具の使い方」は人もロボットも同じはずという前提のもと、人が行う複数の作業動画における道具を使っているシーンから学習し、例えばニンジンの皮を剥く際のニンジンへのピーラーの当て方といった、道具の使い方や力加減を真似することでロボットアームの動作モデルの生成を目指す。

これらの研究を進めることで、人がロボットに言葉で指示をするだけでロボットが自動的に取るべき動作を理解し、道具を使いながら作業を遂行できるようになり、ロボットの社会的意義をこれまで以上に高められる可能性がある。さらにこれらの機能の社会実装を通じて新たな課題発見への期待も見込まれる。

■取組期間

2021年度から2023年度までの3年間

※本共同研究プロジェクトは、日本学術振興会による令和3(2021)年度の科学研究費助成事業 基盤研究(A) 21H04910の支援を受けて遂行。

■各機関の役割

オムロン サイニックエックス:研究プロジェクトの代表者(研究統括)

各機関における研究成果に基づく統合的なシステム開発の主担当

画像や触覚に基づいたロボット制御信号の生成の主担当

各共同研究機関が主として担当する課題の副担当

京都大学大学院情報学研究科

言語指示からの、実行すべき動作系列の生成の主担当

東京工業大学 情報理工学院 情報工学系

画像や触覚に基づいた動作記述を獲得する研究・開発の主担当

奈良先端科学技術大学院大学 先端科学技術研究科 情報科学領域

動作系列を入力としたロボット制御信号の生成に関する研究・開発の主担当